存储是目前IT产业发展的一大热点,而RAID技术是构造高性能、海量存储的基础技术,也是构建网络存储的基础技术。专家认为,磁盘阵列的性能优势得益于

磁盘运行的并行性,提高设备运行并行度可以提高磁盘的性能和数据安全性。

20年来,RAID 推出了一系列级别,包括RAID

0、RAID 1、RAID 2、RAID 3、RAID4、RAID 5,以及各种组合如 RAID 0+1

等。其中最广泛的包括RAID5与RAID10。但是一直以来,关于RAID5与RAID10的性能优劣的争端还是非常多的,甚至很多人包括很多公司都那

拿出了测试数据。而这些测试数据复杂难懂相互矛盾,更加让用户感到迷惑,不知道如何选择。

在这里,我将就这两种RAID的内部运行原理来分析一下,看看我们在什么情况下应当适合选哪一种RAID方式。根据我的经验与分析:

象小io的数据库类型操作,如ERP等等应用,建议采用RAID10,而大型文件存储,数据仓库,如医疗PACS系统、

视频编辑系统则从空间利用的角度,建议采用RAID5。下面请看详细的性能对比:

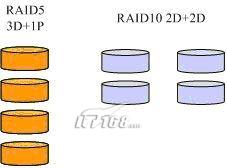

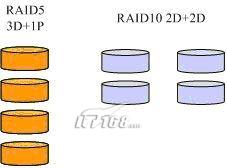

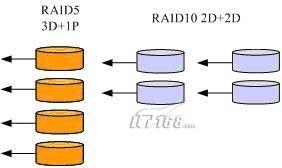

为了方便对比,我这里拿同样多驱动器的磁盘来做对比,RAID5选择3D+1P的RAID方案,RAID10选择2D+2D的Raid方案,分别如图:

那么,我们分析如下三个过程:读,连续写,随机写,但是,在介绍这三个过程之前,我需要介绍另外一个磁盘阵列中的重要概念:cache。

磁

盘读写速度的关键之一:Cache

cache技术最近几年,在磁盘存储技术上,发展的非常迅速,作为高端存储,cache已经是整个存储的核心所在,就是中低端存储,也有很大的cache

存在,包括最简单的RAID卡,一般都包含有几十,甚至几百兆的RAID cache。

cache的主要作用是什么呢?作为缓存,cache的作用具体体现在读与写两个不同的方面:作为写,一般存储阵列只要求数据写到cache就算完成了写

操作,当写cache的数据积累到一定程度,阵列才把数据刷到磁盘,可以实现批量的写入。所以,阵列的写是非常快速的。至于cache数据的保护,一般都

依赖于镜相与电池(或者是UPS)。

cache在读数据方面的作用一样不可忽视,因为如果所需要读取的数据能在cache中命中的话,将大大减少磁盘寻道所需要的时间。因为磁盘从开始寻道到

找到数据,一般都在6ms以上,而这个时间,对于那些密集型I/O的应用可能不是太理想。但是,如果能在cache保存的数据中命中,一般响应时间则可以

缩短在1ms以内。

不要迷信存储厂商的IOPS(每秒的io数)数据,他们可能全

部在cache命中的基础上做到的,但是实际上,你的cache命中率可能只有10%。

介绍完cache,我们就可以解释RAID5与RAID10在不同的模式下,工作效率问题了,那么我们来分别分析读操作、连续写和离散写三方面的问题。

读操作方面的性能差异

如我上文的介绍,磁盘阵列读操作的关键更多的体现在cache的命中率上。所以,RAID5和RAID10在读数据上面,他们基本是没有差别的,除非是读

的数据能影响cache命中率,导致命中率不一样。

连续写方面的性能差异

连续写方面的性能差异

连续写的过程,一般表示写入连续的大批量的数据,如媒体数据流,很大的文件等等。连续写操作大多数产生于医疗PACS系统、高教图书馆系统、视频编辑系统

等等应用环境下。

根据我本人的经验,在连续写操作过程,如果有写cache存在,并且算法没有问题的话,RAID5比RAID10甚至会更好一些,虽然也许并没有太大的差

别。(这里要假定存储有一定大小足够的写cache,而且计算校验的cpu不会出现瓶颈)。

因为这个时候的RAID校验是在cache中完成,如4块盘的RAID5,可以先在内存中计算好校验,同时写入3个数据+1个校验。而RAID10只能同

时写入2个数据+2个镜相。

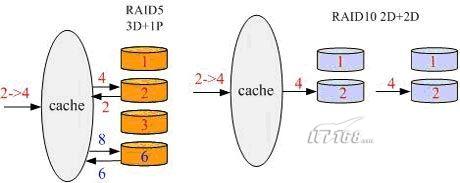

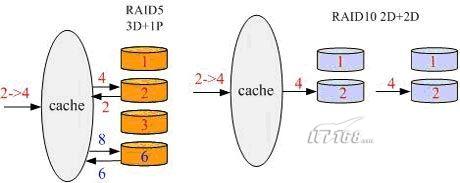

如上图所示,4块盘的RAID5可以在同时间写入1、2、3到cache,并且在cache计算好校验之后,我这里假定是6(实际的校验计算并不是这样

的,我这里仅仅是假设),同时把三个数据写到磁盘。而4块盘的RAID10不管cache是否存在,写的时候,都是同时写2个数据与2个镜相。

根据我前面对缓存原理的介绍,写cache是可以缓存写操作的,等到缓存写数据积累到一定时期再写到磁盘。但是,写到磁盘阵列的过程是迟早也要发生的,所

以

RAID5与RAID10在连续写的情况下,从缓存到磁盘的写操作速度会有较小的区别。不过,如果不是连

续性的强连续写,只要不达到磁盘的写极限,差别并不是太大。 离散写方面的性能差异

这里可能会较难理解,但是,这一部分也是最重要的部分。企业中的绝大部分数据库应用,如ERP系统等等在数据写入的时候其实都是离散写。

例如oracle

数据库每次写一个数据块的数据,如8K;由于每次写入的量不是很大,而且写入的次数非常频繁,因此联机日志看起来会像是连续写。但是因为不保证能够添满

RAID5的一个条带(保证每张盘都能写入),所以很多时候更加偏向于离散写入。

我们从上图看一下离散写的时候,RAID5与RAID10工作方式有什么不同。如上图:我们假定要把一个数字2变成数字4,那么对于RAID5,实际发生

了4次io:

先读出2与校验6,可能发生读命中

然后在cache中计算新的校验

写入新的数字4与新的校验8

如上图我们可以看到:对于RAID10,同样的单个操作,最终RAID10只需要2个io,而RAID5需要4个io。

这里我忽略了RAID5在那两个读操作的时候,可能会发生读命中操作的情况。也就是说,如果需要读取的数据已经在cache中,可能是不需要4个io的。

这也证明了cache对RAID5

的重要性,不仅仅是计算校验需要,而且对性能的提升尤为重要。我本人曾经测试过,在RAID5的阵列中,如果关闭写cache,RAID5的性能将差很多

倍。

当然,我并不是说cache对RAID10就不重要了,因为写缓冲,读命中等,都是提高速度的关键所在,不过的是,RAID10对cache的依赖性没有

RAID5那么明显而已。

到这里,大家应当也大致明白了RAID5与RAID10的原理与差别了,一般来说,象小io的数据库类型操作,建议采用RAID10,而大型文件存储,数

据仓库,则从空间利用的角度,可以采用RAID5。

接下来,我们将进一步分析影响磁盘性能的不同因素,并分析不同的RAID方案对磁盘系统的影响。

前面主要从磁盘系统的内部运行细节分析了RAID5与RAID10的异同,以及各自适用的范围。本文将接续上篇,继续从RAID原理来分析存储系统的瓶

颈。

我们知道,在存储系统的采购过程中,厂商往往能够提供漂亮的性能参数,但实际运行中,该系统的实际性能表现并不能达到我们所期望的状态,那么在运行环境中

存储系统的实际性能究竟受哪些环节和瓶颈的影响呢?

之所以要和大家来讨论这个问题,是因为在本人的工作中曾遇到一个实际的Case,在这个case中,一个恢复压力很大的standby(这里主要是写,而

且是小io的写),采用了RAID5的方案,发现性能很差,后来改造成了RAID10,就很好的避免了性能的问题。

因为性能瓶颈的出现,本身与RAID方式还是有很大关系,同时本文性能讨论的基础,本身建立在上文的一些结论之上。

阵列的瓶颈主要体现在2个方面,带宽与IOPS(单位时间传输的数据量,和单位时间完成的I/O数)。

影响带宽的主要因

素 存储系统的带宽主要取决于阵列的构架,光纤通道的大小(我们今天讨论的阵列一般都是光纤阵列,

SCSI这样的SSA阵列,暂时不在讨论范围之列)以及硬盘的个数。

所谓阵列构架影响存储系统带宽,指的是存储系统内部架构会存在一些内部带宽,类似于PC的系统总线,尽管阵列的构架因不同厂商不同型号的产品而各有不同,

不过一般情况下,内部带宽都设计的很充足,不会是瓶颈的所在。

光纤通道对带宽的影响还是比较大的,例如数据仓库环境中,对数据的流量要求很大,而一块2Gb的光纤卡,所能支撑的最大流量应当是2GB/8=250Mb

/s的实际流量,必须配备4块光纤卡才能达到1Gb/s的实际流量,所以对于数据仓库的环境来说,升级到光纤4Gb并非是厂商过于超前的产品更新,在大流

量的数据环境下绝对有必要考虑更换4GB的光纤卡。

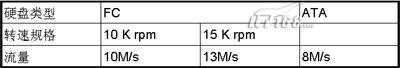

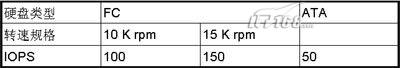

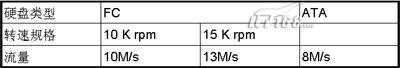

但是对于存储系统的带宽来说,硬盘接口的带宽限制是最重要的。当前面的瓶颈不再存在的时候,带宽就完全取决于硬盘的个数了,我下面列一下不同规格的硬盘所

能支撑的流量大小,数据取自硬盘厂商的标准参数:

如果我们假定一个阵列有120块15K

rpm转速的光纤硬盘,那么硬盘上最大的可以支撑的数据流量为120*13=1560Mb/s,当前端接口不成为瓶颈的时候,1560Mb/s就是理论上

的最大数据流量。

而如果要实现上述的最大带宽,如果前端采用2GB的光纤卡,可能需要配置6块才能够,而4GB的光纤卡,配置3-4块就够了。因此我们可以知道,前端的光

纤接口必须与后端磁盘个数相匹配。

但是否考虑到这些因素就足够了呢,存储系统的整体性能还受到多方面因素的影响,下面我们将分析存储系统的另外一个重要的性能指标:IOPS。

影响IOPS的主要因素

我们前面已经说过了,厂商所提供的IOPS值是在理想状态下测试出来的,对实际的运行性能的参考并不大,所以我们有必要通过以下几个方面来衡量该系统的实

际IOPS的可能表现。

决定IOPS的主要因素取决于阵列的算法,cache命中率,以及磁盘个数。

阵列的算法也因为不同厂商不同型号的产品而不同,如我们最近遇到在HDS

USP上面,可能因为ldev(lun)存在队列或者资源限制,而单个ldev的IOPS就上不去。所以,决定采购某型号的存储之前,有必要了解这个存储

的一些算法规则与限制。

cache命中率对实际IOPS有决定性的影响,Cache命中率取决于数据的分布,cache

size的大小,数据访问的规则,以及cache的算法,如果完整的讨论下来,这里将变得很复杂,可以有一天来慢慢讨论。

我们这里把这些内部原理都省略掉,只强调:对于一个存储阵列来说,读cache的命中率越高,一般就表示它可以支持更多的IOPS,为什么这么说呢?这个

就与我们下面要讨论的硬盘IOPS有关系了。

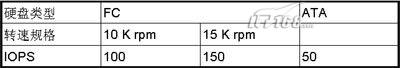

每个物理硬盘能处理的IOPS是有限制的,如

同样,如果一个阵列有120块15K

rpm转速的光纤硬盘,那么,它能支撑的最大IOPS为120*150=18000,这个为硬件限制的理论值,如果超过这个值,硬盘的响应可能会变的非常

缓慢而不能正常提供业务。较高的读cache命中率,能降低硬盘的IOPS负荷,让硬盘在较小的压力下良好工作。

不同

RAID对IOPS性能的影响

在前面我们曾经讨论过,在RAID5与RAID10的不同机制上,读数据时,IOPS性能其实没有差别。但是,相同的业务,在写入数据时,采用不同的

RAID机制最终落在磁盘上的IOPS是有差别的,我们评估的正是磁盘的整体IOPS,如果达到了磁盘的限制,性能肯定是上不去了。

那我们假定一个case,业务应用的IOPS是10000,读cache命中率是30%,读IOPS为60%,写IOPS为40%,磁盘个数为120,那

么分别计算在RAID5与RAID10的情况下,每个磁盘的IOPS为多少。

RAID5:

1. 单块盘的IOPS = (10000*(1-0.3)*0.6 + 4 *

(10000*0.4))/120

2. = (4200 + 16000)/120

3.

= 168

这里的10000*(1-0.3)*0.6表示是读的IOPS,比例是0.6,除掉cache命中,实际只有4200个读IOPS。

而4 * (10000*0.4) 表示写的IOPS,因为每一个写,在RAID5中,实际发生了4个io,所以写的IOPS为16000个。

为了考虑RAID5在写操作的时候,那2个读操作也可能发生命中,所以更精确的计算应该为:

1. 单块盘的IOPS =

(10000*(1-0.3)*0.6 + 2 * (10000*0.4)*(1-0.3) + 2 * (10000*0.4))/120

2. = (4200 + 5600 + 8000)/120

3. =

148

这样我们计算出来单个盘的IOPS为148个,基本达到磁盘IOPS极限,在这种情况下,磁盘的工作状态是非常不理想的。

RAID10对IOPS性能的影响

1. 单块盘的IOPS =

(10000*(1-0.3)*0.6 + 2 * (10000*0.4))/120

2. =

(4200 + 8000)/120

3. = 102

可以看到,因为RAID10对于一个写操作,只发生2次io,所以,同样的压力,同样的磁盘,每个盘的IOPS只有102个,还远远低于磁盘的极限

IOPS。

这里回到我们先前讨论的case上来,在我们先前采用RAID5的时候,通过分析,每个磁盘的IOPS在高峰时期,快达到200了,导致响应速度巨慢无

比。改造成RAID10,每个磁盘的IOPS降到100左右,很好的避免了这个性能问题。

因此,综合以上讨论我们可以得出结论:

影响读数据的关键因素是cache命中率,在读数据的情况下,RAID5与

RAID10性能本身没有太大差别。但是对于写数据的一些应用,尤其是小I/O频繁写入的一些应用,如企业ERP生产系统等等,RAID10相比

RAID5可能产生较大的性能差异。而大型文件存储,数据仓库,如医疗PACS系统、视频编辑系统则从空间利用的角度,建议采用RAID5。